急速なAI技術の進展、特に生成AIの普及により、私たちのビジネスや生活は劇的な変化を遂げています。

しかし、その利便性の裏側には、プライバシーの侵害、著作権問題、不当な差別といった倫理的リスクが潜んでいます。

現在、世界中で「AIをいかに正しく、安全に活用するか」という議論が加速しており、日本国内でも政府による指針の策定や企業の自主的な取り組みが活発化しています。

本記事では、AI倫理ガイドラインの最新動向から、具体的な策定方法、企業の成功事例までを詳しく解説し、組織が信頼されるAI活用を実現するための道筋を提示します。

AI倫理ガイドラインとは何か

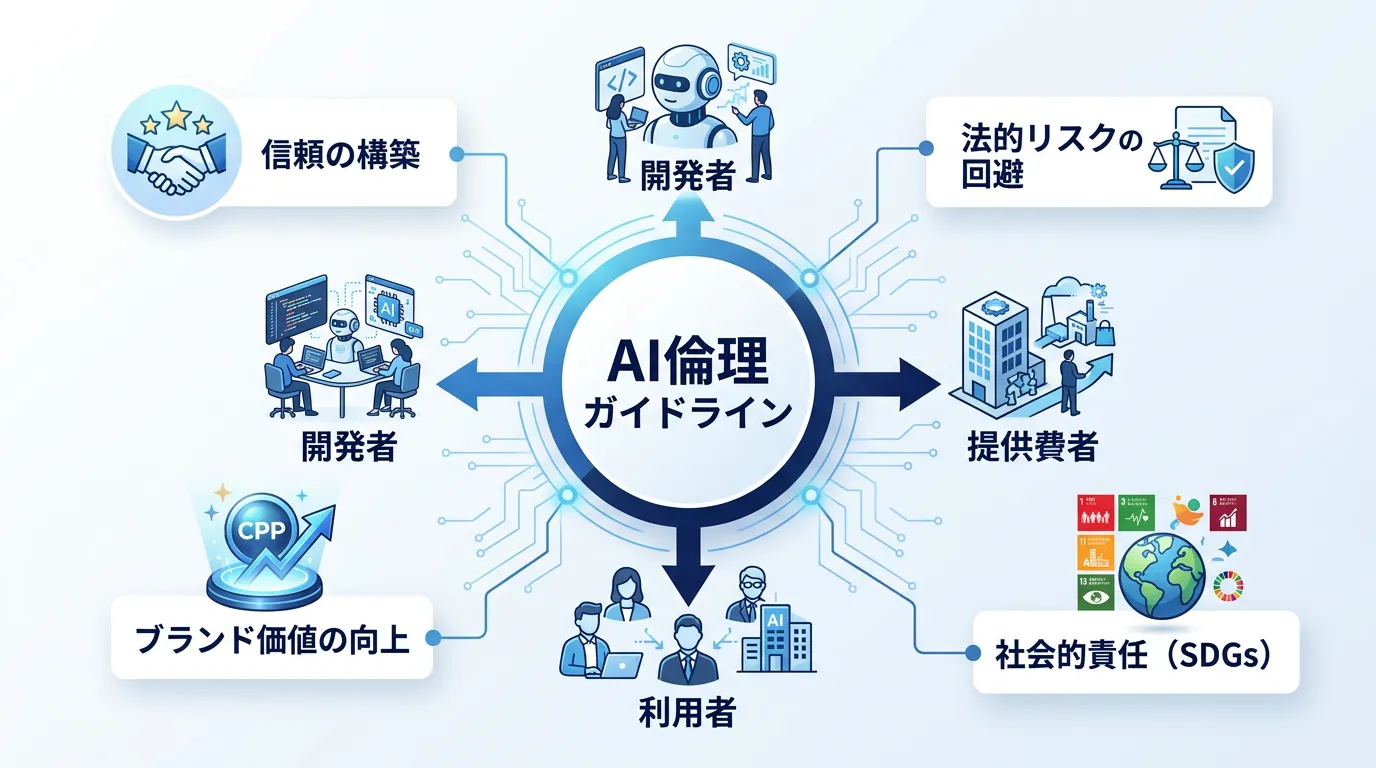

AI倫理ガイドラインとは、AIの開発、提供、および利用において、人間中心の原則に基づき、社会的な不利益を回避するために定められた非拘束的な行動規範を指します。

法律のような法的拘束力(ハードロー)とは異なり、組織が自律的に守るべき「ソフトロー」として位置づけられることが一般的です。

AIは従来のプログラムとは異なり、学習データに基づいて予測や判断を自動的に行います。

そのため、意図せずとも学習データに含まれる偏見を学習してしまったり(バイアスの増幅)、判断プロセスがブラックボックス化して説明が困難になったりする特性があります。

これらの課題に対処し、「人間中心のAI社会」を実現するために、ガイドラインは以下の役割を担います。

- リスクの予見と回避

開発段階で予期せぬ差別や不利益が生じないようチェックリストとして機能する。

- 透明性の確保

どのようなデータを使用し、どのような目的でAIを運用しているかをステークホルダーに明示する。

- 社会的信頼の獲得

倫理的な配慮を宣言することで、顧客やパートナー企業からの信頼を高める。

現在、多くの企業が独自のAI倫理ガイドラインを策定しているのは、単なるリスク管理にとどまらず、AI活用の正当性を担保し、持続可能なイノベーションを推進するためなのです。

世界と日本におけるAI規制・ガイドラインの潮流

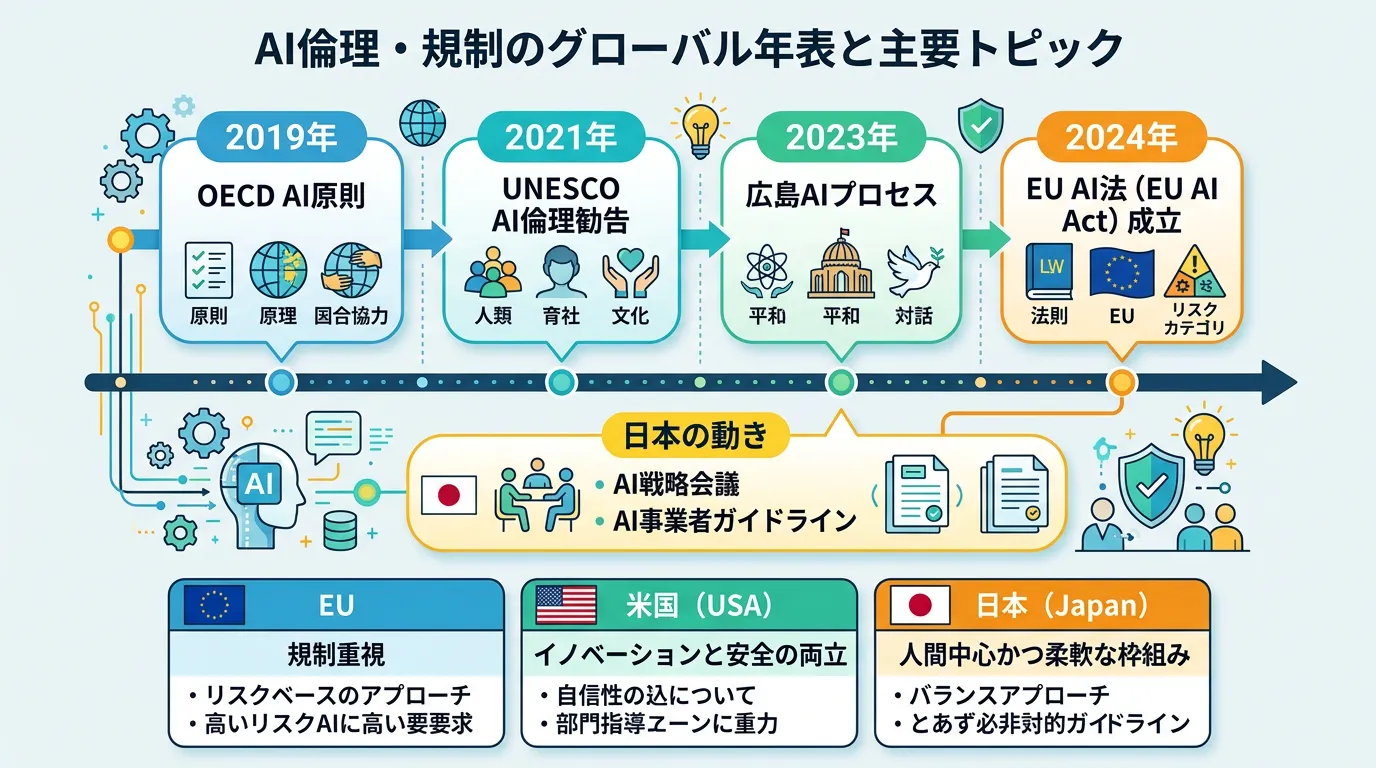

AIを巡るルール作りは、今や国際的な最重要課題となっています。

欧州、米国、そして日本と、それぞれの地域で異なるアプローチが取られていますが、共通しているのは「リスクに基づいた管理」という考え方です。

国際的な動向:EU AI法と広島AIプロセス

世界で最も厳しい規制を導入したのが欧州連合(EU)です。

2024年に成立したEU AI法は、AIをリスクの高さに応じて4段階に分類し、禁止や厳格な義務を課しています。

一方で、G7の枠組みで主導された「広島AIプロセス」では、生成AIに焦点を当てた国際的な指針が合意されました。

これは、開発者向けの行動規範(International Code of Conduct for Organizations Developing Advanced AI Systems)を定め、偽情報対策やコンテンツ認証技術の開発を求めています。

日本の動向:柔軟なガバナンスへの移行

日本はこれまで、イノベーションを阻害しないよう、法的規制よりも「非拘束的なガイドライン」による柔軟な対応を重視してきました。

内閣府の「人間中心のAI社会原則」を上位概念とし、経済産業省や総務省がより具体的な実務指針を提示しています。

特に注目すべきは、2024年4月に公開された「AI事業者ガイドライン(第1.0版)」です。

これは、従来の「AI利活用ガイドライン」などを統合したもので、現在のAIビジネスにおける「バイブル」とも言える存在です。

政府が策定した「AI事業者ガイドライン」の詳細解説

経済産業省と総務省が合同で作成した「AI事業者ガイドライン」は、AIの開発者、提供者、利用者が共通して遵守すべき指針を体系化したものです。

このガイドラインでは、全てのAIに関係する事業者が取り組むべき事項として、以下の10の共通原則を掲げています。

| 原則項目 | 内容の概要 |

|---|---|

| 人間中心 | AIは人間の尊厳を尊重し、代替するものではなく支援するものであること。 |

| 安全性 | 身体、生命、財産を侵害せず、安全に配慮した設計・運用を行うこと。 |

| プライバシー | 個人情報の適切な取り扱いと、プライバシーの保護を徹底すること。 |

| 公正性 | 不当な差別や偏見を排除し、公平な意思決定を支援すること。 |

| 透明性 | AIの判断根拠や特性を可能な限り公開し、説明可能性を追求すること。 |

| 説明責任 | 万が一のトラブル時に、責任の所在を明確にし説明できる体制を持つこと。 |

| セキュリティ | サイバー攻撃やデータの改ざんからAIシステムを保護すること。 |

| 民主主義の尊重 | 民主的プロセスを侵害するような偽情報の拡散や世論操作を防止すること。 |

| イノベーション | 公正な競争環境を保ち、技術の進化を止めないこと。 |

| 持続可能性 | 環境負荷の低減や、長期的な社会への貢献を目指すこと。 |

特に生成AIに関しては、「入力データの権利保護」や「生成物の真実性の確認」など、より具体的な留意事項が盛り込まれています。

企業がAIを導入する際は、まずこのガイドラインに照らし合わせて自社の活用状況をチェックすることが推奨されます。

企業のAI倫理ガイドライン策定・運用事例

多くの先進企業は、政府の指針をベースに自社のビジョンや事業特性に合わせた独自のガイドラインを策定しています。

ここでは代表的な3つの事例を紹介します。

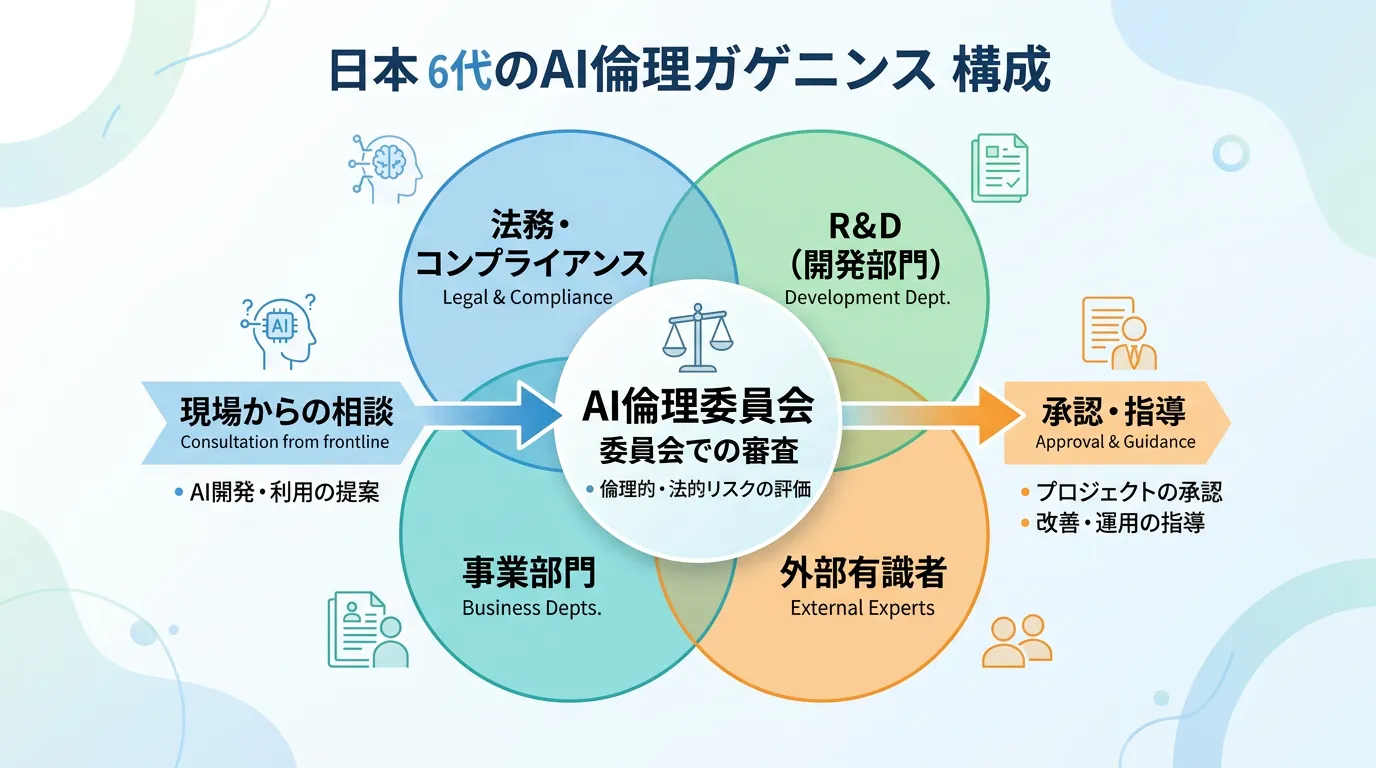

1. ソニーグループ(Sony Group)

ソニーは2018年に「ソニーグループAI倫理指針」を策定し、早い段階からAIガバナンスに取り組んできました。

特徴的なのは、全グループを対象とした「AI倫理委員会」の設置です。

開発部門がAIを利用する際、倫理的リスクが懸念されるプロジェクトについては、この委員会が詳細な審査を行います。

単なる禁止ではなく、どうすればリスクを抑えて社会に貢献できるかという視点で議論が行われています。

2. ソフトバンク(SoftBank)

ソフトバンクは、AIの急速な普及を受け、従業員が生成AIを安全に利用するための詳細なガイドラインを定めています。

特に「情報の入力ルール」を徹底しており、社外秘の情報や個人情報を入力しないようシステム側でのフィルタリングと教育をセットで実施しています。

また、「AI活用による生産性向上」を掲げつつ、その過程で人間の創造性をいかに守るかという哲学も含まれています。

3. 富士通(Fujitsu)

富士通は「AI倫理外部有識者委員会」を設置し、外部の客観的な視点を取り入れています。

さらに、AIの公平性や説明可能性を自動で評価するAI Ethics for AIという技術的なアプローチも推進しています。

ガイドラインを「紙の文書」にとどめず、技術的なツールとして実装している点が特徴です。

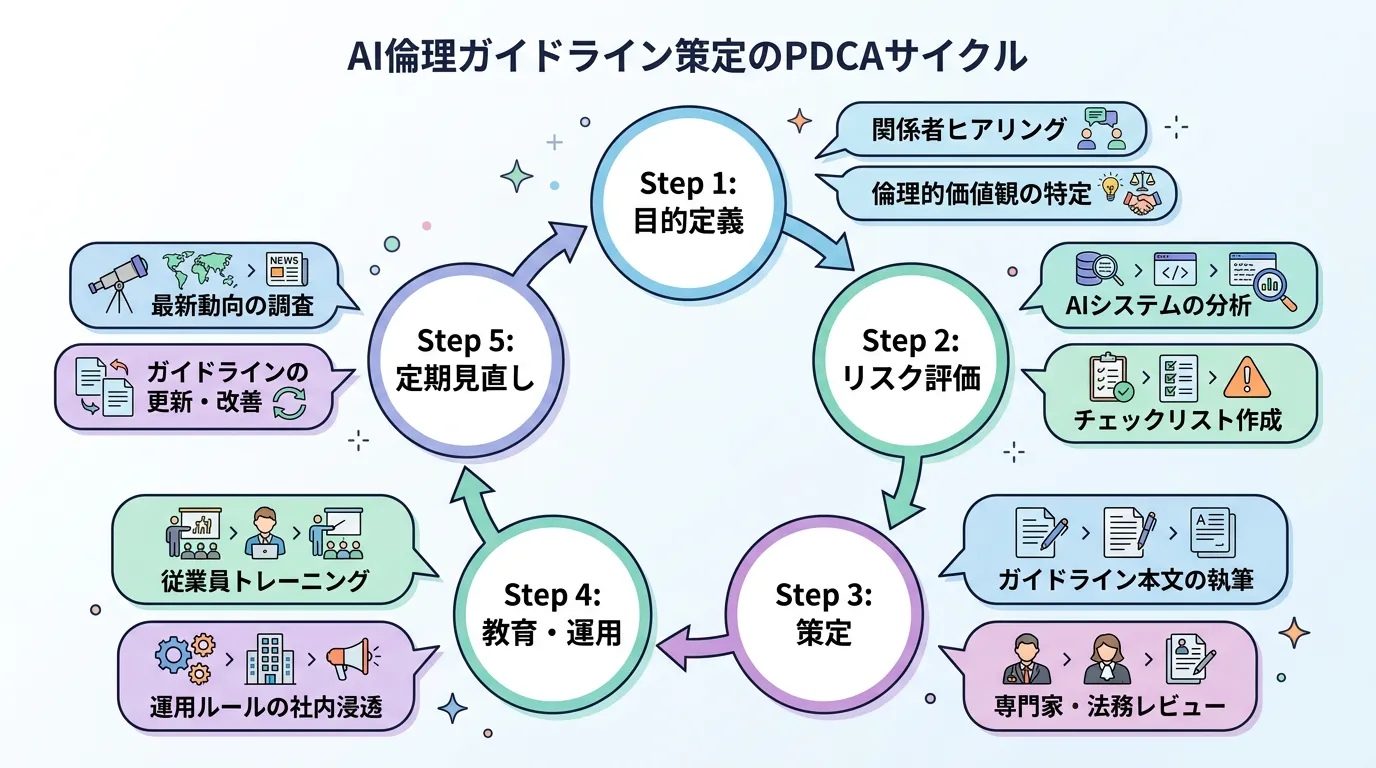

自社でAI倫理ガイドラインを策定するための5ステップ

これからガイドラインを策定する企業にとって、何から手をつけるべきかは大きな課題です。

以下の5つのステップで進めることで、形骸化しない実効性のあるガイドラインを作成できます。

ステップ1:目的と適用範囲の明確化

なぜ自社にAI倫理が必要なのか、その目的を定義します。

「顧客の信頼獲得」なのか「法的リスクの回避」なのかを明確にし、対象範囲(社内開発のみか、外部ツールの利用も含むか)を決めます。

ステップ2:現状のAI活用状況とリスクの洗い出し

社内のどの部署で、どのようなAIが使われているかを棚卸しします。

- 機密情報の漏洩リスク

- 著作権侵害の可能性

- 採用等における不当な差別の有無これらを具体的にリストアップします。

ステップ3:ガイドラインの起案と組織体制の整備

「AI事業者ガイドライン」を参考に、自社の行動規範を作成します。

同時に、疑問が生じた際やトラブルが起きた際の相談窓口(AI倫理担当や委員会)を設置します。

ステップ4:全社教育とツールの導入

ガイドラインは作っただけでは意味がありません。

全社員に向けたリテラシー教育を行い、なぜその制限があるのかという背景を含めて理解を促します。

また、生成AIを利用する場合は、入力ブロック機能などのツール導入も検討しましょう。

ステップ5:モニタリングと定期的なアップデート

AI技術は日々進化しています。

また、法規制の動向も常に変化します。

少なくとも年に一度は内容を見直し、最新の状況に合わせてガイドラインを更新し続けることが重要です。

AI倫理を巡る今後の課題と展望

AI倫理は、一度策定すれば終わりというものではありません。

今後、企業が直面するであろういくつかの重要な課題があります。

まず、「説明責任の具体化」です。

ディープラーニングなどの複雑なAIが「なぜその結果を出したのか」を人間が理解できる形で示すことは、技術的にも難易度が高い課題です。

しかし、医療や金融などの重要分野では、XAI(説明可能なAI)の導入が今後ますます求められるでしょう。

次に、「著作権と学習データの透明性」です。

生成AIが学習に使用したデータの出所を明示する動き(C2PAなどの技術標準)が活発化しています。

企業としては、自社が利用するAIがどのようなデータに基づいているか、クリーンな学習が行われているかを確認する責任が生じています。

最後に、「ガバナンスの自動化」です。

人手によるチェックには限界があります。

今後は、AIの出力が倫理的かどうかを別のAIが監視・評価する「AIによるAIの統制」が主流になっていくと考えられます。

まとめ

AI倫理ガイドラインは、企業のAI活用における「ブレーキ」ではなく、アクセルを安心して踏むための「安全装置」です。

- 政府の指針(AI事業者ガイドライン)を土台にする

- 自社のビジネスモデルに合わせた具体的なルールを作る

- 策定して満足せず、教育と運用のサイクルを回す

これらの取り組みを通じて、AIの恩恵を最大化しつつ、社会的責任を果たすことが可能になります。

AIの進化が止まらない今こそ、組織として「AIとどう向き合うか」という倫理的スタンスを明確に示すことが、長期的な競争優位性を生む鍵となるでしょう。

まずは、政府が公開している最新のガイドラインを一読し、自社の現状と照らし合わせることから始めてみてはいかがでしょうか。