AI(人工知能)技術の急速な進展により、私たちのデジタル体験は劇的な変化を遂げています。

その一方で、実在の人物の顔や声を精巧に模倣するディープフェイク(Deepfake)の脅威が現実味を帯びてきました。

かつては専門的な技術が必要だった偽動画の作成も、現在では安価なツールやアプリで誰でも簡単に行えるようになっています。

この技術はエンターテインメント分野での活用が期待される反面、政治的な世論操作や詐欺、プライバシー侵害といった深刻な社会問題を引き起こす要因にもなっています。

本記事では、プロの視点から最新のディープフェイクの見分け方と、それに対抗する最先端の検知技術について詳しく解説します。

情報を正しく見極め、偽情報に惑わされないためのリテラシーを身につけるためのガイドとしてご活用ください。

ディープフェイクとは何か?その仕組みと進化

ディープフェイクとは、Deep Learning(深層学習)とFake(偽物)を組み合わせた造語です。

主にAIを用いて、画像、動画、音声を合成・改変する技術を指します。

生成技術の核となるGANと拡散モデル

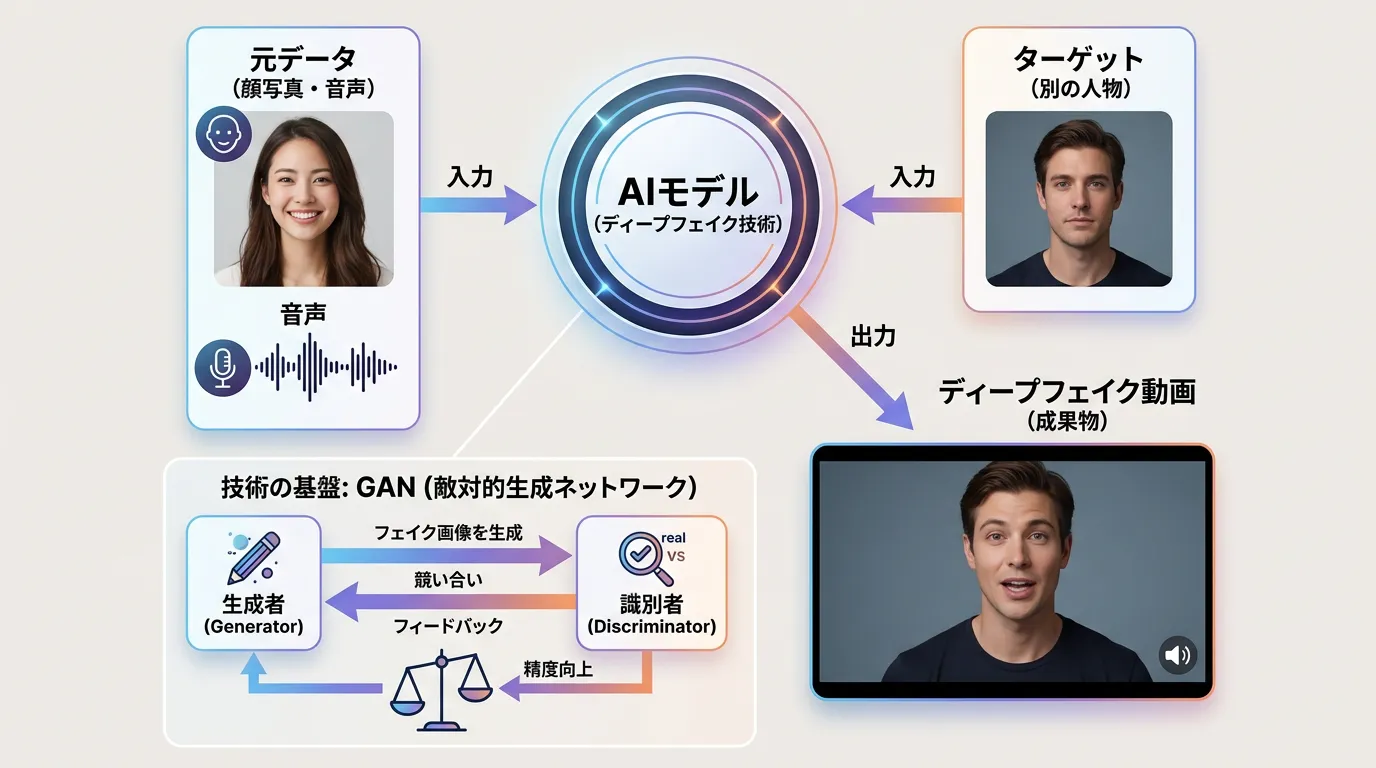

ディープフェイクの品質を飛躍的に向上させたのは、GAN(Generative Adversarial Networks:敵対的生成ネットワーク)と呼ばれる技術です。

これは、「偽物を作るAI(生成者)」と「それを見破るAI(識別者)」を戦わせることで、人間には判別不可能なほど精巧なデータを生成する仕組みです。

さらに最近では、拡散モデル(Diffusion Models)という新しい技術も登場しています。

これにより、低画質な素材からでも高精細な偽動画を作成したり、テキスト入力だけで実写に近い動画を生成したりすることが可能になりました。

これらの技術進化により、もはや「動画だから証拠になる」という常識は通用しなくなっているのが現状です。

人間の目でディープフェイクを見抜く「視覚的違和感」のポイント

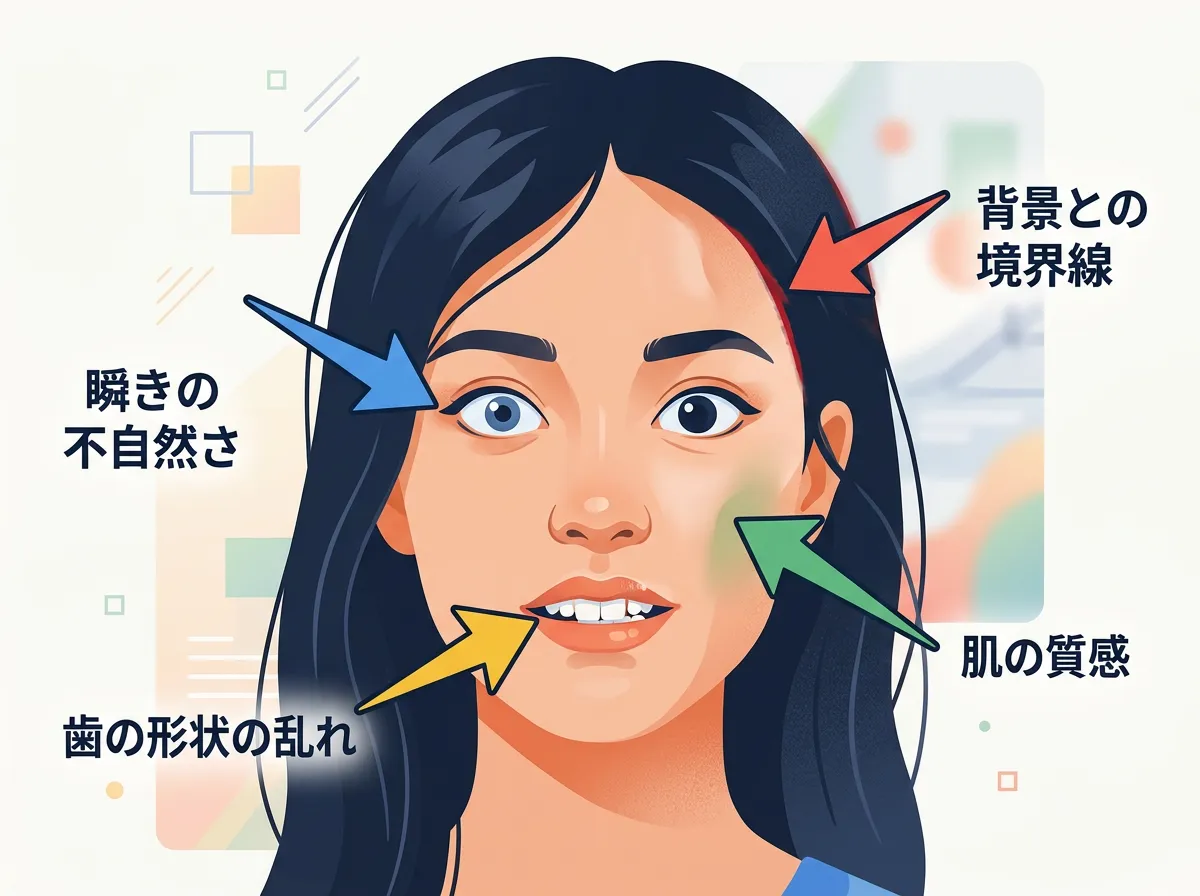

AIがどれほど進化しても、現時点では物理的な法則や微細な身体的特徴の再現に「歪み」が生じることがあります。

私たちが動画を視聴する際に意識すべきチェックポイントを整理しました。

1. 瞬きの回数とリズム

人間は通常、数秒に一度、無意識に瞬きをします。

初期のディープフェイクAIは「目を開けている画像」を学習データとして多用していたため、瞬きが極端に少なかったり、リズムが機械的であったりする傾向がありました。

現在では改善されつつありますが、依然として「不自然に長い凝視」や「左右の目の動きが同期していない」といった違和感は有力な判断材料になります。

2. 口元と発話の同期(リップシンク)

音声と唇の動きが完全に一致しているかを確認してください。

ディープフェイクでは、特定の音(「ま」「ば」「ぱ」などの唇を閉じる音)を発する際に、唇の形が不自然に崩れたり、歯の形状がぼやけたりすることがよくあります。

また、口の中に「本来あるべきはずの影」がない、あるいは歯が一本の白い塊のように見える場合も注意が必要です。

3. 肌の質感と影のつき方

AIは滑らかな肌を生成するのは得意ですが、微細なシワ、毛穴、産毛、そして複雑な光の反射を再現するのは苦手です。

- 顔の輪郭に沿って不自然な「ぼかし」が入っていないか。

- 照明の方向と、鼻や目の下に落ちる影の方向が矛盾していないか。

- メガネをかけている場合、フレームの反射が左右で不自然に異なっていないか。

これらの要素を詳細に観察することで、合成の痕跡を見つけ出せる可能性があります。

4. アクセサリーや背景の歪み

顔そのものだけでなく、周辺要素にも注目しましょう。

耳の形が左右で違っていたり、イヤリングが急に消えたり形が変わったりするのは、AIがそれらを「一つの物体」として正しく認識できていない証拠です。

また、人物が動いた際に背景がぐにゃりと歪む現象(アーティファクト)も、ディープフェイク特有の兆候です。

最新の検知技術とツール:AIでAIを見破る

人間の目によるチェックには限界があります。

そこで重要になるのが、コンピュータサイエンスを用いたディープフェイク検知技術です。

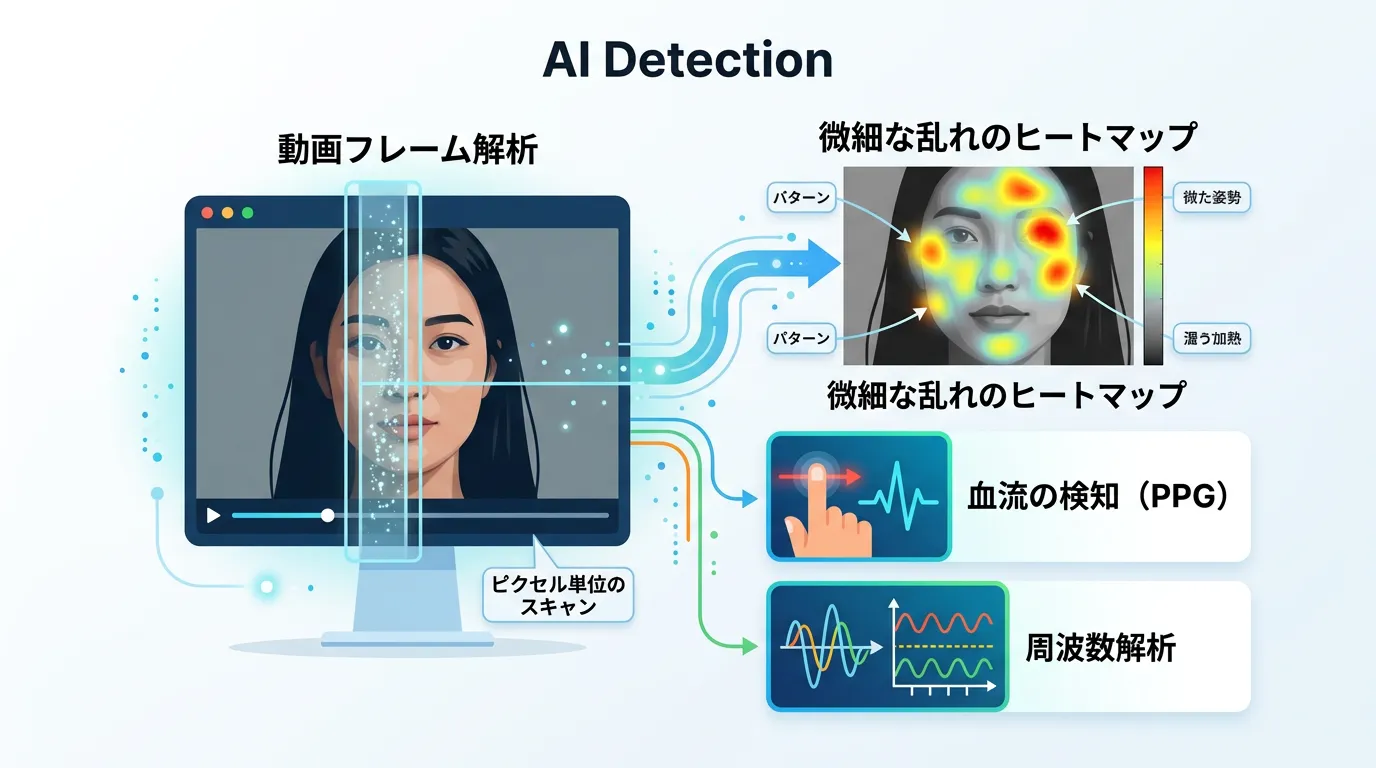

生体信号の解析(PPG技術)

人間が生きている限り、心臓の鼓動に合わせて顔の表面には微細な血流の変化が生じます。

これをフォトプレチスモグラフィ(PPG)と呼びます。

インテル(Intel)が開発した「FakeCatcher」などの技術は、動画内の人物の顔からこの微細な血流変化を読み取ります。

本物の人間であれば規則的な血流パターンが検出されますが、ディープフェイク動画ではこの血流信号が検出されないか、支離滅裂なパターンを示すため、極めて高い精度で偽物を見分けることができます。

ピクセルレベルの不自然なパターン解析

AIが動画を生成する際、人間には見えない「指紋」のような特有のパターンが残ります。

検知ツールは、ピクセルごとの色の連続性や周波数成分を解析し、カメラのレンズを通した自然な映像か、それともAIによる合成映像かを判定します。

主要な検知ツールとプラットフォーム

現在、いくつかの企業や組織が検知ツールを提供しています。

| ツール/技術名 | 提供元 | 主な特徴 |

|---|---|---|

| Video Authenticator | Microsoft | 動画の各フレームをリアルタイムで解析し、フェイクの確率を数値化。 |

| FakeCatcher | Intel | 血流の変化(PPG)を利用した世界初のリアルタイム検知器。 |

| Deepware Scanner | Deepware | オンラインで動画ファイルをアップロードして解析できる一般向けツール。 |

これらの技術は、SNSプラットフォームや報道機関において、デマの拡散を防ぐための重要な盾となっています。

技術だけでは防げない?「来歴証明」という新しいアプローチ

ディープフェイク技術がさらに高度化し、検知技術との「いたちごっこ」が激化する中で、近年注目されているのが「来歴証明(Provenance)」という考え方です。

これは「偽物を見つける」のではなく、「本物であることを証明する」アプローチです。

C2PAとデジタル署名

C2PA(Coalition for Content Provenance and Authenticity)は、Adobe、Microsoft、Intel、ソニー、ニコンなどが主導する標準化団体です。

この技術では、カメラで撮影した瞬間に、その画像がいつ、どこで、どの機材で撮られたかという情報を「コンテンツクレデンシャル(Content Credentials)」としてメタデータに埋め込み、暗号化します。

もし後からAIで加工された場合、その履歴がすべて記録され、署名が壊れる仕組みになっています。

これにより、ユーザーは「この動画は未加工の本物である」という確証を持ってコンテンツを視聴できるようになります。

電子透かし(デジタルウォーターマーク)

Googleが発表したSynthIDのように、AIが生成した画像や音声に、人間の目には見えないがコンピュータには読み取れる特殊な透かしを埋め込む技術も導入が進んでいます。

これにより、たとえトリミングや色調補正が行われても、そのコンテンツがAI製であることを後から追跡可能になります。

私たちが今日からできる対策とリテラシー

ディープフェイクを見破るための技術は進化していますが、最も重要なのは私たち一人ひとりの情報に対する姿勢です。

1. 「衝撃的な動画」ほど疑う

ディープフェイクは、人々の感情を揺さぶり、怒りや恐怖を煽るために使われることが多いです。

有名人の不適切発言や、衝撃的な事件の映像を目にしたときは、即座にシェアするのではなく、一呼吸置いて「一次ソースはどこか?」「他の信頼できるメディアは報じているか?」を確認する癖をつけましょう。

2. 「S.I.F.T.」メソッドの活用

偽情報を見極めるためのフレームワークとして、以下の4ステップ(SIFT)が推奨されています。

- S (Stop):立ち止まる。感情的に反応する前に、まず落ち着く。

- I (Investigate):情報源を調査する。その発信者は信頼できるか?

- F (Find):より良い裏付けを探す。他の複数のソースと照らし合わせる。

- T (Trace):元の文脈を辿る。断片的な切り抜きではないか確認する。

3. セキュリティ設定の強化

個人を標的にしたディープフェイク詐欺(上司の声で送金指示を出す、家族を装うなど)も増えています。

- SNSでの顔写真や動画の公開範囲を制限する。

- 組織内では「合言葉」を決めておくなど、アナログな認証手段を併用する。

- 音声だけの指示を鵜呑みにせず、ビデオ通話や別ルートでの確認を行う。

まとめ

ディープフェイク技術は、私たちの社会に利便性と創造性をもたらす一方で、真実を歪める強力な武器にもなり得ます。

現在の検知技術は「瞬きの不自然さ」や「血流の解析」によって高い精度を実現していますが、AIの進化スピードは速く、完全な自動検知に依存するのは危険です。

今後は、C2PAなどの来歴証明技術による「本物の証明」が標準化されていくでしょう。

しかし、それ以上に重要なのは、私たち利用者が「目に見えるものが常に真実とは限らない」という認識を持ち、常にクリティカルな視点で情報を精査する力(メディアリテラシー)を磨き続けることです。

技術を正しく理解し、適切なツールとリテラシーを組み合わせることで、私たちはAI時代の偽情報という荒波を乗り越えていくことができるはずです。